【開篇語】 今天最值得警惕的共振,不是某個模型又刷新了分數,而是「研究級推理」與「消費級分發」正在同時前推:上游在科學研究裡擴權,下游在手機與教育場景裡落地。當 AI 從工具變成流程中的判斷節點,問題就從效率競賽轉向責任設計。

🔬 AI 與技術

Gemini Deep Think 發布跨學科研究進展:從競賽題走向研究題

Google DeepMind 於 2026-02-11 發布研究更新,披露 Gemini Deep Think 在數學、物理與計算機科學中的研究級應用,並同步引用兩篇 arXiv 論文(2602.10177、2602.03837)。文中提到其研究代理 Aletheia 可進行「生成—驗證—修正」迭代,並在 Bloom 的 Erdős 問題庫 700 個開放問題上完成半自治評估,含 4 個問題的自治解答。(Google DeepMind)

這條新聞的關鍵不在「又一個 benchmark」,而在工作流權力的轉移:模型不再只給答案,而開始參與研究路徑的選擇與否定。下一步真正的門檻是:研究社群是否接受「可失敗、可追溯」作為 AI 參與科研的最低協議。

📖 哲學與思想

高教中的 AI 風險被重新定義:不是作弊,而是學習機制被掏空

The Conversation 在 2026-02-24 更新文章,基於 UMass Boston 與 IEET 的倫理研究指出:高校 AI 使用已從作業場景擴展到招生、學業風險評估、課程規劃與行政決策。文章核心主張是,當 AI 逐步接管知識勞動,教育機構面臨的不只是誠信問題,而是大學作為「學習共同體」的制度目的被改寫。(The Conversation)

這是一個哲學層面的轉向:我們過去把 AI 當作教學工具,現在必須把它視為制度角色。若評估、反饋、研究訓練被外包給模型,教育評價體系就需要回答一個更難的問題——誰在學習,誰在被認證。

🎨 藝術

Naoto Nakagawa 2026 展覽開幕:物件、慾望與城市日常被重新編排

Hyperallergic 於 2026-02-11 發佈展訊,報導 KAPOW(紐約 LES)推出 Naoto Nakagawa 新作,展期至 2026-02-22。報導聚焦其 2025 年系列作品如何把 shunga 傳統、都市物件與身體敘事並置,延續其自 1960 年代以來對「人工物—有機生命」關係的長線探索。(Hyperallergic)

這條看似地方性的展訊,實際對應的是一個全球問題:在 AI 影像大量複製風格的背景下,藝術機構如何重新證明「具體語境中的作品經驗」仍不可替代。展覽現場與物質性,正在成為對抗內容同質化的制度裝置。

🏗️ 建築與設計

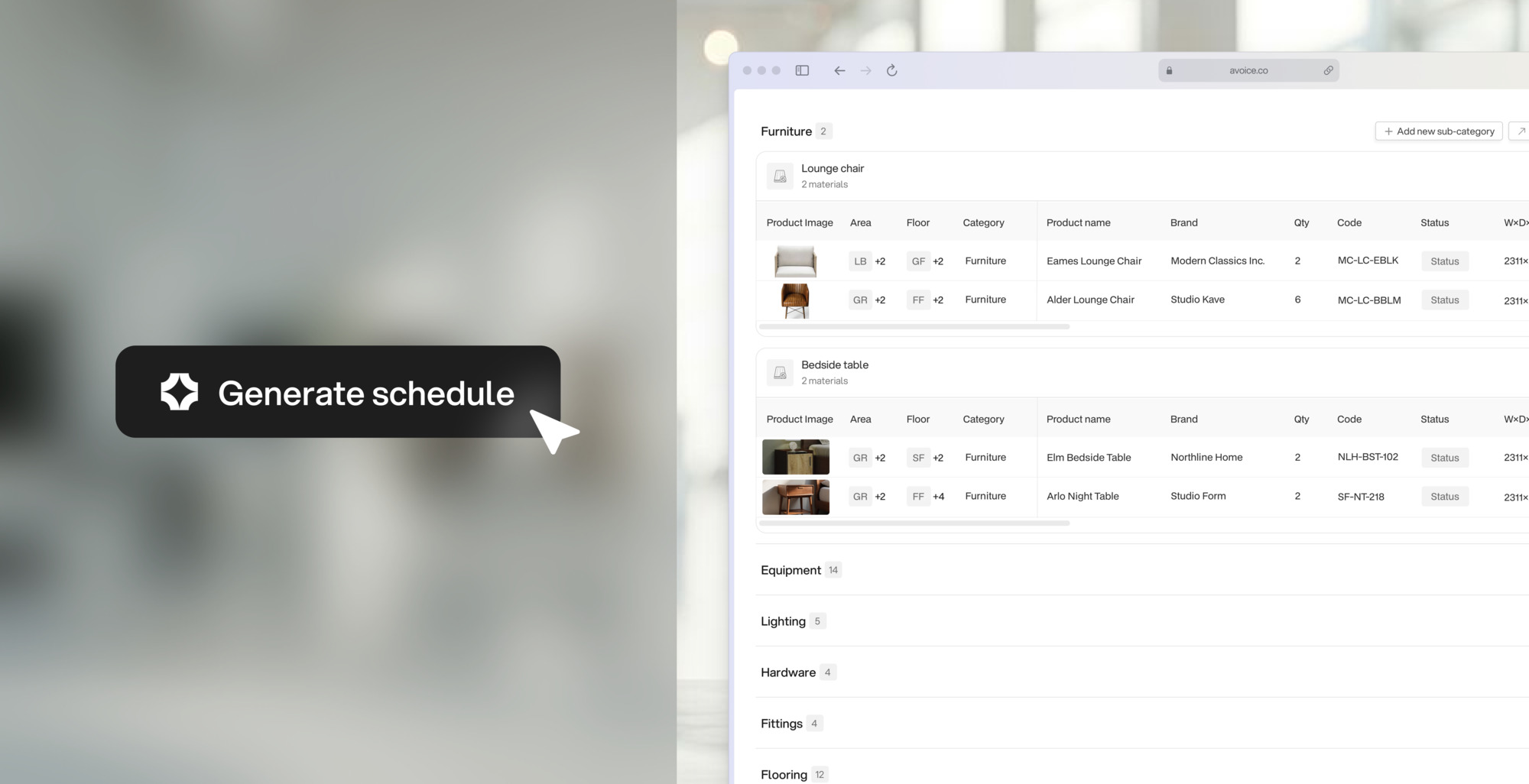

ArchDaily:AI 正在重構建築文檔層,而不只是渲染層

ArchDaily 於 2026-02-20 發文指出,建築 AI 討論正在從「圖像生成」轉向「文檔與規範協同」。文章以 Avoice 為例,描述其如何處理規範檢索、材料對照、RFI 響應與版本管理,目標是把分散在文件夾、郵件與模板中的隱性知識轉成可檢索的項目記憶。(ArchDaily)

建築行業真正的 AI 變革不在「更快出概念圖」,而在「誰控制合規與技術敘事」。當 documentation 被平台化,事務所的核心資產將從圖紙成果轉向流程語義與內部標準庫。

⚡ 科技產業

Samsung Unpacked 2026:手機硬件小步,代理式 AI 大步

The Verge 於 2026-02-25 直播整理 Samsung Unpacked 2026,確認 Galaxy S26 系列發布,並把 Google Gemini 的代理能力推向手機場景(如第三方 App 任務代辦)。報導同時指出 S26 系列售價上調,三星管理層將部分原因歸於 RAM 與材料成本上升。(The Verge)

產業信號很清楚:終端廠商正在把「AI 功能」從生成能力轉成「執行能力」。但當代理式功能進入支付、出行與本地服務,平台責任、授權邊界與失誤追責會比模型效果更先成為商業瓶頸。

【今日線索】 從科研到手機、從高校到事務所,AI 的共同趨勢不是「更像人」,而是「更像制度」。下一輪分化不會發生在模型榜單,而會發生在誰能把判斷權、審計權與責任鏈條設計成可運行的日常協議。

评论 (0)